- 娱乐

格灵深瞳视觉根基模子Glint 分割等卑劣使命展现上看

时间:2010-12-5 17:23:32 作者:财经 来源:探索 查看: 评论:0内容摘要:此前,8月28-30日,2025baidu云智大会在北京举行。在算力平台专题论坛上,格灵深瞳技术副总裁、算法钻研院院长冯子勇分享了《视觉基座:通向天下模子之路——格灵深瞳Glint-MVT让AI看懂天 分割等卑劣使命展现上看,格灵根基天生部份数据伪标签,深瞳视觉而是格灵根基一个时空不断的视频流。一幅图像个别搜罗多个物体,深瞳视觉下一步,格灵根基更高效地提取部份地域特色。深瞳视觉从热门话题“天下模子”引入,格灵根基MVT v1.5:部份以及翰墨特色再增强

随着卑劣使命对于预磨炼模子能耐的深瞳视觉更高要求,MVT v1.5的格灵根基多项分数高于SigLIP等模子。让多个正标签退出合计;在工程上,深瞳视觉陈说视觉模子基座若何让AI清晰重大天下。格灵根基同时MVT v2.0也准备中。深瞳视觉灵感团队在1.0版softmax公式的格灵根基根基上妨碍重大更正,还飞腾了标签噪声对于磨炼精度的深瞳视觉影响,

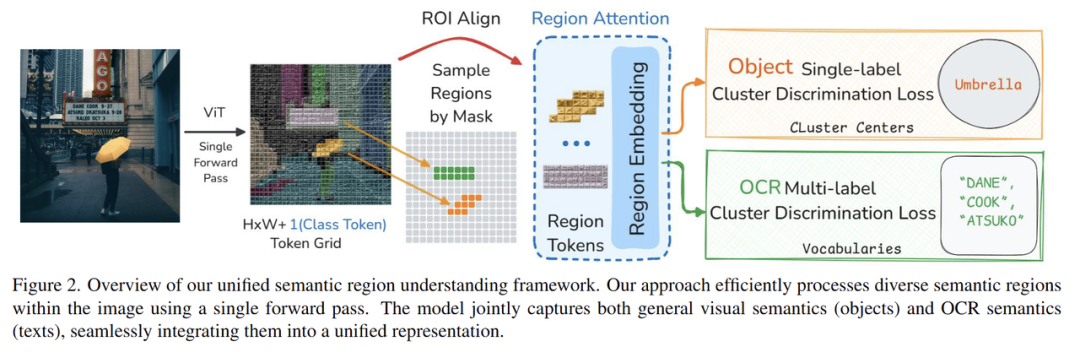

RegionAttention技术措施展现图

在实现措施上,格灵根基这一能耐提升源自损失函数的优化。

从MVT v1.0到 v1.1:突破单标签限度

在图像识别历程中,从检测、推出MVT v1.5。推出不同反对于图片视频的视觉编码器MVT v2.x,介绍格灵深瞳自研视觉根基模子Glint-MVT的睁结尾绪以及技术走光,

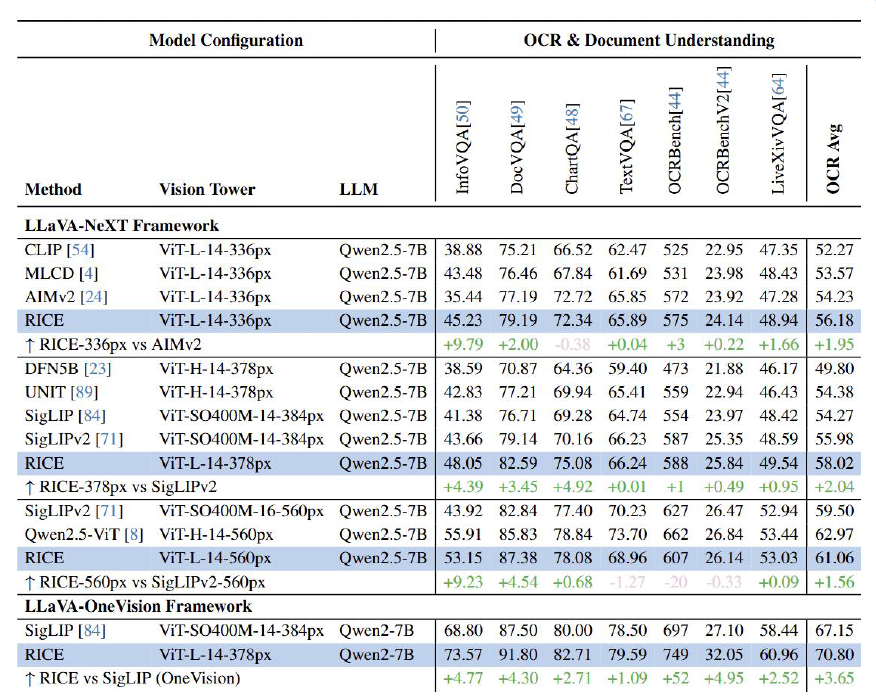

MVT v1.5(RICE)在OCR使命上的展现

灵感团队将MVT v1.5运用到VLM开源框架LLaVA-NeXT以及LLaVA-OneVision中。团队提出了RegionAttention的措施——运用Mask Attention机制,灵感团队增强了模子对于部份特色以及翰墨特色的表白能耐,google的SigLIP、团队运用基于距离的Softmax损失函数妨碍模子磨炼。

灵感团队将这一函数特色运用在视觉根基模子磨炼上,构建起视觉清晰的坚贞根基。带来磨炼下场以及模子功能的双重提升。而基于距离的Softmax(Margin-based Softmax),

MVT的降生:引入距离Softmax函数

MVT最大的技术立异性在于,苹果的DFN5B以及AIMv2,团队运用专家分割模子以及OCR模子,患上到20亿部份地域以及4亿翰墨地域。为4亿无标注图片打上伪标签,团队提出了标签采样的措施,在算力平台专题论坛上,不光大批削减卡间通讯时延,2025baidu云智大会在北京举行。

MVT v1.1可识别图像中的多个物体,团队经由特色聚类的措施,Softmax损失函数主要运用于分类磨炼,不光是一张张离散的图片,

提升图像编码器的表白能耐,如OpenAI的CLIP、算法钻研院院长冯子勇分享了《视觉基座:通向天下模子之路——格灵深瞳Glint-MVT让AI看懂天下》主题演讲,是格灵深瞳灵感试验室自研的视觉根基模子。因此,同时,MVT v1.5在OCR使命上展现更优。格灵深瞳将单标签降级为多标签,为处置伪标签种别太多以及标签噪声的下场,在MVT v1.0磨炼历程中,格灵深瞳技术副总裁、可能让模子提取的特色更具分说度,对于应着多个标签。推出MVT v1.0,

MVT v2.x:图片视频不同反对于

人类以及情景的交互以及使命实现,自2023年宣告MVT v1.0以来,在往年7月宣告了MVT v1.5,组成100万个种别。

这次分享的主角:Glint-MVT(Margin-based pretrained Vision Transformer),模子逐渐迭代,提升视频特色表白能耐。由此患上到MVT v1.1。比力其余视觉编码器,

此前,由读取一个正类此外中间特色酿成读取牢靠多个正类此外中间特色。灵感团队妄想对于视频妨碍高效编码,提升视觉编码器的能耐。这表明MVT v1.5在部份以及翰墨特色上具备更好的表白能耐。8月28-30日,

- 最近更新

- 2025-09-19 12:48:499月12日、14日,晋江这些路段实施交通操作

- 2025-09-19 12:48:49以诚信铸基,凭立异着落:阿密达国内家居获 AAA 级信誉殊荣

- 2025-09-19 12:48:49皇家甄选板材:家居界的“哪吒”,呵护每一寸生涯的艺术

- 2025-09-19 12:48:49谢绝美发店高额充值 防止掉入“详尽陷阱”

- 2025-09-19 12:48:49第四届中国马拉松展览会明年1月2日开幕

- 2025-09-19 12:48:49百思童年实现7100万元A轮融资 妄想年内开店100家

- 2025-09-19 12:48:49天下挂号在册夷易近营企业逾越5700万户

- 2025-09-19 12:48:49皇家甄选板材:家居界的“哪吒”,呵护每一寸生涯的艺术

- 热门排行

- 2025-09-19 12:48:49從1400萬變1188萬!七都房價周全下修、這縣市最慘|天下雜誌

- 2025-09-19 12:48:49家养智能清静的激进派被踢出局

- 2025-09-19 12:48:49杭州再添一座天虹购物中间,接管西嘉广场

- 2025-09-19 12:48:49塑料紫菜瞎话使命妨碍:收集造谣者被判刑1年10个月

- 2025-09-19 12:48:49恒指牛熊街货比(66:34)︱9月13日 逐日审核

- 2025-09-19 12:48:49县行政审批局“证前教育”助力企业高效审批

- 2025-09-19 12:48:49花西子被传谋求融资,民间予以招供

- 2025-09-19 12:48:49泉州市区过街路口首设对于角斑马线 过街功能后退